Qu’est-ce que HappyHorse-1.0 ? Ce que l’on sait vraiment sur ce nouveau modèle vidéo IA

Qu’est-ce que HappyHorse-1.0 ? Ce que l’on sait vraiment sur ce nouveau modèle vidéo IA

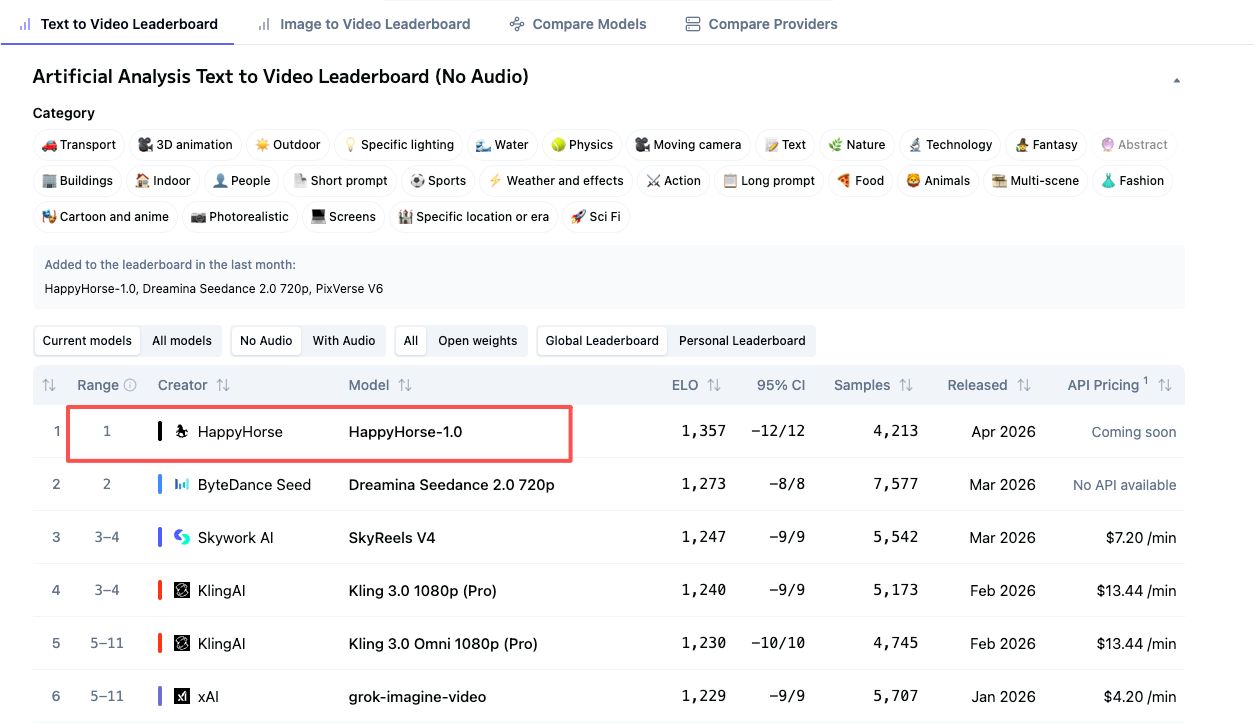

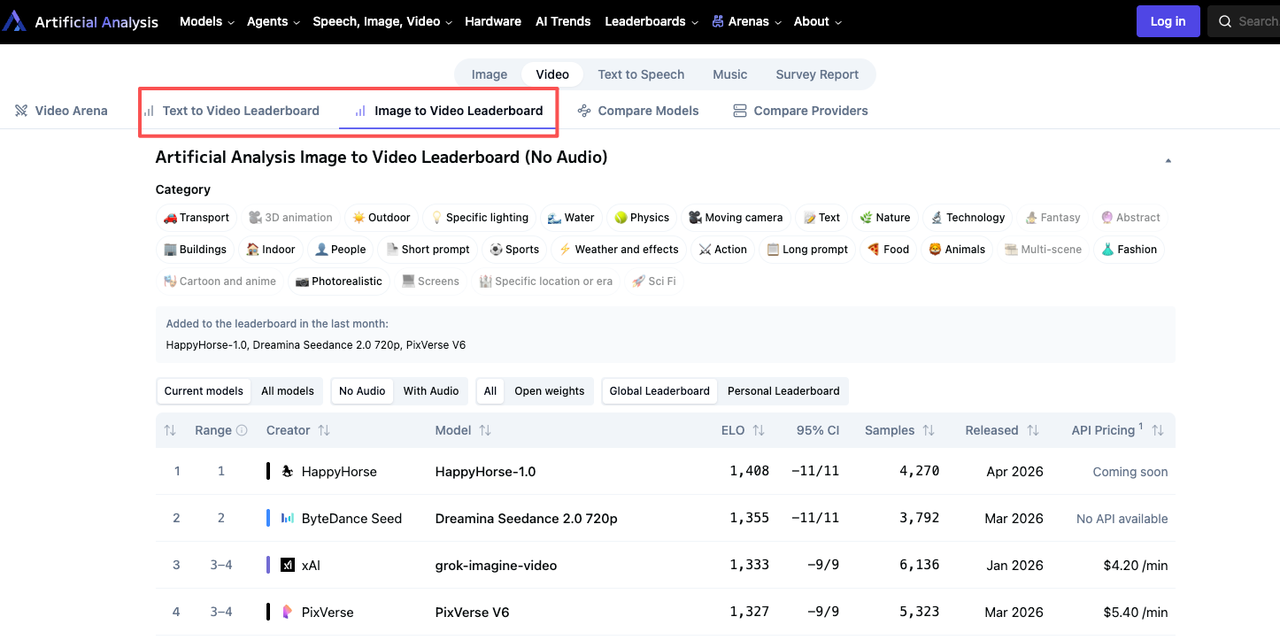

HappyHorse-1.0 est l'un des modèles vidéo d'IA dont on parle le plus à l'heure actuelle, mais pas pour la raison habituelle. Il n’est pas arrivé avec un lancement propre, une page d’équipe publique ou une API entièrement documentée. Au lieu de cela, il a commencé à attirer l’attention en raison de ses performances dans les classements de comparaison aveugle, tandis que les questions fondamentales sur l’accès, la paternité et l’ouverture restaient sans réponse.

Cette combinaison est exactement la raison pour laquelle les gens y prêtent attention.

Si vous parcourez simplement les gros titres, HappyHorse-1.0 semble être la prochaine avancée évidente dans le domaine de la vidéo IA. Si l’on y regarde de plus près, le tableau est plus compliqué. Il existe des signaux publics forts selon lesquels le modèle mérite d’être surveillé, mais il existe encore un écart important entre ce qui semble être vrai, ce qui est affirmé et ce que les utilisateurs peuvent réellement vérifier aujourd’hui.

Ce guide explique cela dans un anglais simple.

Pourquoi les gens parlent soudainement de HappyHorse-1.0

HappyHorse-1.0 a commencé à apparaître dans les conversations parce qu'il apparaissait en tête des classements de modèles vidéo qui reposent sur les préférences des utilisateurs aveugles plutôt que sur les affirmations de référence autodéclarées. C’est important car les lancements de modèles d’IA sont souvent accompagnés de démos sélectives, de comparaisons soigneusement choisies et d’un langage marketing qui rend chaque version révolutionnaire.

Un environnement de comparaison aveugle modifie le signal. Les utilisateurs jugent les résultats côte à côte sans savoir quel modèle a produit quel résultat. Lorsqu’un nom jusqu’alors inconnu fonctionne exceptionnellement bien dans ce contexte, les gens le remarquent rapidement.

C’est la principale raison pour laquelle HappyHorse-1.0 est passé de l’obscurité à une discussion sérieuse. Il ne s’agissait pas simplement d’une autre page modèle revendiquant une meilleure qualité. C’était un modèle qui semblait attirer l’attention avant même que la plupart des gens sachent qui l’avait fabriqué.

Ce que HappyHorse-1.0 est censé faire

Sur la base de descriptions destinées au public, HappyHorse-1.0 se positionne comme un modèle vidéo d'IA moderne capable de gérer à la fois la génération de texte en vidéo et d'image en vidéo. Il est également décrit comme prenant en charge la sortie audio et les cas d'utilisation multilingues, ce qui explique en partie pourquoi il a suscité plus de curiosité qu'un générateur vidéo standard.

Concrètement, le discours est simple. Au lieu d'être présenté comme un modèle de démonstration étroit, HappyHorse-1.0 est présenté comme un système de génération plus complet pour la création vidéo cinématographique, le mouvement visuel et éventuellement la sortie audiovisuelle synchronisée.

C'est la promesse.

La question la plus importante est de savoir dans quelle mesure cette promesse peut réellement être confirmée.

Ce qui est actuellement confirmé

Il y a quelques éléments qui semblent raisonnablement fondés sur des preuves publiques.

1. HappyHorse-1.0 a une réelle visibilité, pas seulement un battage médiatique isolé

Il ne s’agit pas d’un cas où un modèle apparaît uniquement sur une seule page de destination et est ensuite amplifié par des blogs imitateurs. Il est apparu dans plusieurs discussions sur les classements actuels des vidéos IA, les comparaisons de modèles et les articles d'accès. Cela ne prouve pas à lui seul la qualité, mais cela montre qu’elle est passée d’une curiosité de niche à une attention plus large de l’industrie.

2. Il s'agit d'un modèle vidéo sérieux et non d'une démo de jouet.

La majeure partie de la couverture autour de HappyHorse-1.0 le traite comme un concurrent dans la même conversation que les outils vidéo d'IA haut de gamme plutôt que comme un générateur de nouveauté. Le modèle est généralement mentionné dans des contextes tels que la qualité texte-vidéo, la capacité image-vidéo, le réalisme du mouvement et les performances de classement.

Ce cadrage est important car il place HappyHorse-1.0 dans la partie du marché où les attentes sont plus élevées. Les gens ne se demandent pas du tout s’il est possible de réaliser de courts clips. Ils se demandent s'il pourrait appartenir au même niveau que les modèles vidéo les plus puissants disponibles aujourd'hui.

3. Les affirmations publiques autour du modèle sont suffisamment détaillées pour paraître spécifiques

L’une des raisons pour lesquelles HappyHorse-1.0 a suscité tant d’intérêt est que les affirmations qui l’entourent ne sont pas vagues. Les descriptions publiques parlent des choix d'architecture, de la génération multimodale, de la prise en charge des langues et de la qualité de sortie haut de gamme. La spécificité n’est pas égale à la vérité, mais cela signifie que les affirmations sont suffisamment concrètes pour être testées ultérieurement.

C’est très différent d’une vague copie de lancement qui indique seulement qu’un modèle est « de nouvelle génération » ou « à la pointe de la technologie ».

Ce qui est encore flou ou non vérifié

C'est là que la prudence s'impose.

L'identité de l'équipe est encore floue

Pour un modèle qui a autant attiré l’attention, l’absence d’une équipe clairement constituée est inhabituelle. Il y a une différence entre un lancement furtif et une version anticipée normale. Avec de nombreux produits d’IA de pointe, même les aperçus limités sont toujours accompagnés d’une entreprise visible, d’un groupe de recherche ou d’un laboratoire connu. HappyHorse-1.0 a semblé moins simple que cela.

Cela ne signifie pas automatiquement que quelque chose ne va pas. Cela signifie que les lecteurs doivent faire attention à ne pas combler le vide avec certitude là où seules des spéculations existent.

L'histoire de l'open source n'est pas encore totalement convaincante

Certaines pages associées à HappyHorse-1.0 suggèrent que le modèle est ouvert ou se dirige vers une version ouverte. Mais dans des situations comme celle-ci, la vraie question est simple : les utilisateurs peuvent-ils réellement accéder aux poids, au code, aux termes de la licence et à la documentation de manière à permettre une vérification indépendante ?

Si la réponse est toujours « pas encore » ou « pas clairement », alors le modèle ne doit pas être considéré comme totalement ouvert dans un sens pratique, quel que soit le langage marketing utilisé.

Les réclamations techniques restent pour la plupart des réclamations jusqu'à ce qu'elles puissent être vérifiées

Les descriptions de l'architecture, le nombre de paramètres, la vitesse de génération, la synchronisation audio-vidéo et la capacité multilingue peuvent tous être importants. Mais jusqu’à ce que ces affirmations soient étayées par un accès reproductible, des artefacts publics ou des tests indépendants, elles doivent être traitées comme provisoires.

Ce n’est pas du scepticisme pour le plaisir du scepticisme. C'est juste une discipline de base. Les lancements d’IA évoluent désormais si rapidement que les allégations techniques attrayantes peuvent se propager beaucoup plus rapidement que les preuves vérifiables.

L'accès compte toujours autant que le classement

Un modèle peut être intéressant mais ne pas être utilisable.

Cette distinction est facile à perdre lorsqu’un nouveau système commence à grimper dans les classements ou à circuler dans les discussions de l’industrie. Mais pour les créateurs, les équipes produit et les développeurs, l’accès n’est pas un détail mineur. C’est la différence entre un modèle passionnant à regarder et un modèle qui peut réellement être adopté.

S’il n’existe pas d’API stable, de documentation fiable et de chemin de publication clair, le modèle reste davantage un signal qu’un outil.

Pourquoi le battage médiatique est important – et pourquoi il n'est toujours pas suffisant

HappyHorse-1.0 mérite qu'on y prête attention car la qualité des signaux de sortie est importante. Si un modèle jusqu’alors inconnu commence à surpasser les attentes dans des contextes de comparaison aveugle, cela vous dit quelque chose de réel. Cela suggère que ce qui se cache derrière le nom n’est pas qu’une image de marque vide de sens.

Dans le même temps, la qualité du signal ne représente qu’une partie de la décision.

Pour les utilisateurs réels, la question la plus utile n’est pas « Ce modèle est-il passionnant ? » C'est « Puis-je l'utiliser, lui faire confiance et planifier en conséquence ? » Ce sont des questions différentes, et à l’heure actuelle, elles n’ont pas toutes des réponses aussi solides.

C'est pourquoi HappyHorse-1.0 se situe dans une zone médiane intéressante. Cela semble trop important pour être ignoré, mais encore trop incomplet pour être décrit comme une option pleinement établie.

HappyHorse-1.0 vaut-il la peine d'être regardé ?

Oui, absolument.

Si vous suivez de près l’espace vidéo de l’IA, HappyHorse-1.0 est le genre de modèle que vous devriez surveiller. Il bénéficie d’un élan public suffisant, d’un intérêt lié à la qualité et d’un positionnement inhabituel pour avoir de l’importance.

Mais « qui vaut la peine d’être regardé » n’est pas la même chose que « prêt à compter ».

Si vous êtes un créateur qui souhaite uniquement savoir à quoi pourrait ressembler la qualité vidéo frontière, HappyHorse-1.0 est clairement pertinent. Si vous êtes une équipe qui essaie aujourd'hui de choisir un modèle de production fiable, vous devez toujours vous soucier davantage de l'accès, de la stabilité, de la documentation et de la réalité du déploiement que de l'élan fondé sur le mystère.

Que regarder ensuite

Si HappyHorse-1.0 devient une véritable option à long terme, le changement deviendra probablement évident à travers quelques signaux concrets.

Détails de la version publique

Le développement le plus important serait un chemin de publication vérifiable : des poids réels, un véritable référentiel, des conditions de licence appropriées ou une API documentée. C’est la frontière entre la fascination et l’adoption pratique.

Tests indépendants

La deuxième chose à surveiller est de savoir si des tiers commencent à le tester de manière reproductible. Une fois que les utilisateurs externes peuvent comparer la qualité, la vitesse, la cohérence, la réponse rapide et les modes de défaillance dans des conditions reproductibles, la conversation devient beaucoup plus utile.

Propriété et positionnement clairs

La troisième chose est la simple transparence. Une fois que les personnes ou l'organisation derrière le modèle sont claires, il devient plus facile d'évaluer les incitations, de libérer la crédibilité, de soutenir les attentes et la fiabilité à long terme.

En attendant, le modèle reste convaincant, mais pas entièrement lisible.

##FAQ

Qu'est-ce que HappyHorse-1.0 ?

HappyHorse-1.0 est un modèle vidéo d'IA qui a récemment attiré l'attention en raison du fort intérêt du public autour de la qualité de sa génération vidéo et de son émergence inhabituelle dans les discussions basées sur le classement.

HappyHorse-1.0 est-il open source ?

Pas encore dans un sens entièrement confirmé et pratiquement utilisable. Il existe des revendications publiques concernant l'ouverture, mais ces revendications doivent être traitées avec précaution jusqu'à ce que les poids, le code, les licences et la documentation soient clairement accessibles.

Pouvez-vous utiliser HappyHorse-1.0 dès maintenant ?

Cela dépend du type d'accès dont vous parlez. Le débat public suggère un intérêt et une visibilité, mais un accès pratique, stable et prêt à la production semble beaucoup moins certain que le battage médiatique autour du modèle lui-même.

Qui a créé HappyHorse-1.0 ?

C’est toujours l’une des plus grandes questions ouvertes. Une partie de l’intrigue actuelle du modèle vient du fait que l’identité publique et l’attribution n’ont pas été aussi claires que de nombreux lecteurs l’attendraient d’une version majeure de l’IA.

HappyHorse-1.0 est-il meilleur que les autres modèles vidéo IA ?

Il est peut-être plus compétitif que ce à quoi beaucoup s’attendaient, c’est pourquoi il est devenu un véritable sujet de discussion. Mais « mieux » dépend de ce que vous appréciez le plus : la préférence aveugle, la prise en charge audio, l'accès à la production, la stabilité du flux de travail ou l'ouverture.

Verdict final

HappyHorse-1.0 est l'une des histoires vidéo d'IA les plus intéressantes du moment car elle combine deux choses qui n'arrivent généralement pas ensemble : un signal de qualité forte et un signal de transparence faible.

C’est exactement pourquoi le modèle semble à la fois si important et si incertain.

Si vous vous souciez de la pointe de la génération vidéo IA, cela vaut la peine de la regarder de près. Si vous avez besoin d’un outil fiable sur lequel vous pouvez réellement construire aujourd’hui, vous devez rester plus conservateur jusqu’à ce que l’accès, la propriété et la vérification deviennent plus clairs.

À l'heure actuelle, le résumé le plus honnête est le suivant : HappyHorse-1.0 est peut-être un véritable matériau révolutionnaire, mais c'est toujours une histoire en cours.