O que é o HappyHorse-1.0? O que realmente sabemos sobre esse novo modelo de vídeo com IA

O que é o HappyHorse-1.0? O que realmente sabemos sobre esse novo modelo de vídeo com IA

HappyHorse-1.0 é um dos modelos de vídeo de IA mais comentados do momento, mas não pelo motivo usual. Ele não chegou com um lançamento limpo, uma página pública da equipe ou uma API totalmente documentada. Em vez disso, começou a chamar a atenção devido ao seu bom desempenho em classificações de comparação cega, enquanto questões básicas sobre acesso, autoria e abertura permaneciam sem resposta.

Essa combinação é exatamente a razão pela qual as pessoas estão prestando atenção.

Se você apenas folhear as manchetes, o HappyHorse-1.0 parece o próximo avanço óbvio em vídeo de IA. Se você olhar mais de perto, o quadro é mais complicado. Há fortes sinais públicos de que vale a pena observar o modelo, mas ainda existe uma lacuna significativa entre o que parece ser verdade, o que está sendo afirmado e o que os usuários podem realmente verificar hoje.

Este guia explica isso em inglês simples.

Por que as pessoas de repente estão falando sobre HappyHorse-1.0

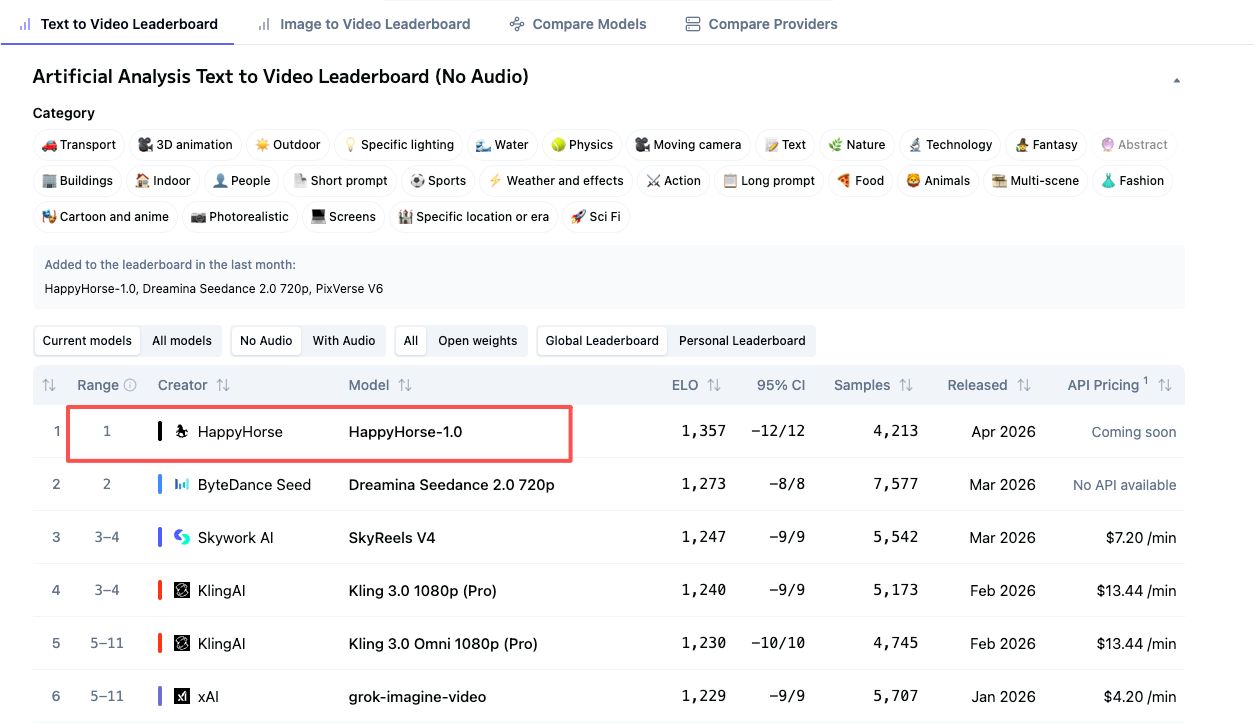

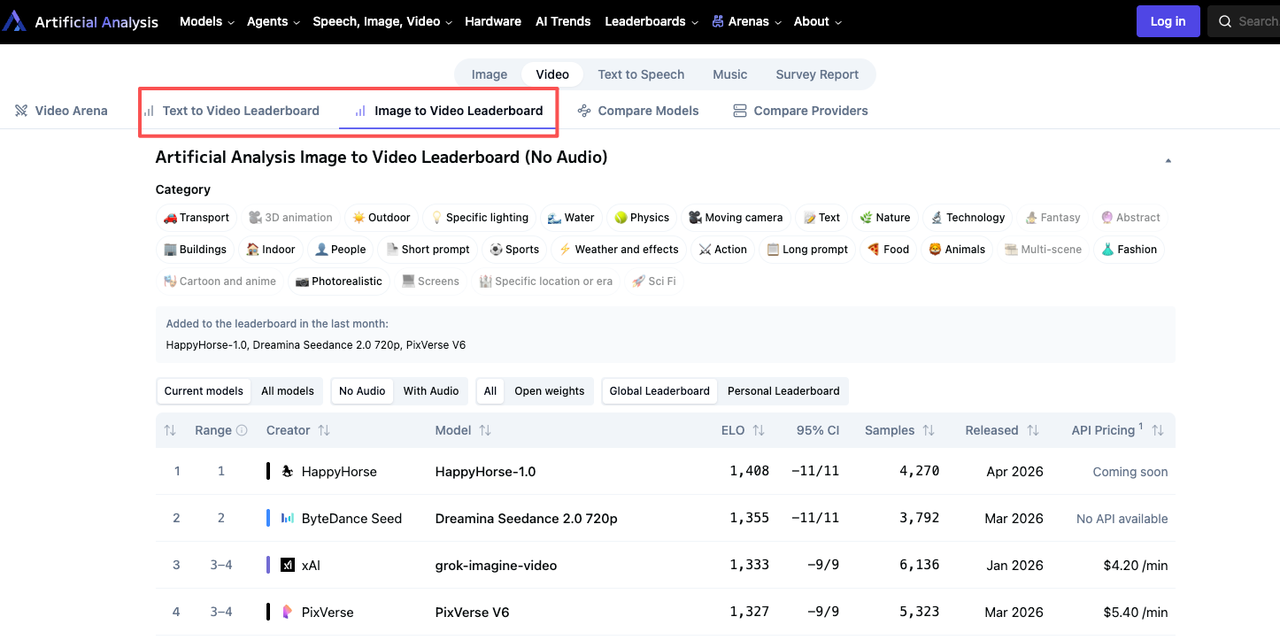

HappyHorse-1.0 começou a aparecer nas conversas porque apareceu perto do topo das classificações de modelos de vídeo que dependem da preferência do usuário cego, em vez de afirmações de benchmark auto-relatadas. Isso é importante porque os lançamentos de modelos de IA geralmente vêm embrulhados em demonstrações seletivas, comparações cuidadosamente escolhidas e linguagem de marketing que fazem com que cada lançamento pareça revolucionário.

Um ambiente de comparação cega altera o sinal. Os usuários julgam os resultados lado a lado sem saber qual modelo produziu qual resultado. Quando um nome até então desconhecido tem um desempenho excepcionalmente bom nesse ambiente, as pessoas percebem rapidamente.

Essa é a principal razão pela qual o HappyHorse-1.0 passou da obscuridade para uma discussão séria. Não era apenas mais uma página modelo reivindicando melhor qualidade. Era um modelo que parecia estar chamando a atenção antes mesmo que a maioria das pessoas soubesse quem o havia feito.

O que o HappyHorse-1.0 deve fazer

Com base em descrições públicas, o HappyHorse-1.0 é posicionado como um modelo de vídeo de IA moderno que pode lidar com a geração de texto para vídeo e imagem para vídeo. Ele também é descrito como compatível com saída com reconhecimento de áudio e casos de uso multilíngue, um dos motivos pelos quais atraiu mais curiosidade do que um gerador de vídeo padrão.

Em termos práticos, o discurso é direto. Em vez de ser enquadrado como um modelo de demonstração restrito, o HappyHorse-1.0 está sendo apresentado como um sistema de geração mais completo para criação de vídeo cinematográfico, movimento visual e, possivelmente, saída audiovisual sincronizada.

Essa é a promessa.

A questão mais importante é até que ponto dessa promessa pode realmente ser confirmada.

O que realmente está confirmado agora

Existem algumas coisas que parecem razoavelmente fundamentadas em evidências públicas.

1. HappyHorse-1.0 tem visibilidade real, não apenas exagero isolado

Este não é o caso em que um modelo apareceu apenas em uma única página de destino e depois foi amplificado por blogs imitadores. Ele apareceu em várias discussões sobre classificações atuais de vídeos de IA, comparações de modelos e artigos de acesso. Isso por si só não prova qualidade, mas mostra que ela passou da curiosidade de nicho para a atenção mais ampla da indústria.

2. Está sendo discutido como um modelo de vídeo sério, não como uma demonstração de brinquedo

A maior parte da cobertura em torno do HappyHorse-1.0 o trata como um concorrente na mesma conversa que ferramentas de vídeo de IA de ponta, e não como um gerador de novidades. O modelo é geralmente mencionado em contextos como qualidade de texto para vídeo, capacidade de imagem para vídeo, realismo de movimento e desempenho de classificação.

Esse enquadramento é importante porque coloca o HappyHorse-1.0 na parte do mercado onde as expectativas são maiores. As pessoas não estão perguntando se é possível fazer clipes curtos. Eles estão perguntando se ele pode pertencer ao mesmo nível dos modelos de vídeo mais potentes disponíveis atualmente.

3. As afirmações públicas em torno do modelo são detalhadas o suficiente para parecerem específicas

Um dos motivos pelos quais o HappyHorse-1.0 gerou tanto interesse é que as afirmações em torno dele não são vagas. As descrições públicas falam sobre opções de arquitetura, geração multimodal, suporte a idiomas e qualidade de saída de ponta. Especificidade não é igual a verdade, mas significa que as afirmações são suficientemente concretas para serem testadas mais tarde.

Isso é muito diferente da vaga cópia de lançamento que apenas diz que um modelo é “próxima geração” ou “estado da arte”.

O que ainda não está claro ou não foi verificado

É aqui que a cautela se torna necessária.

A identidade da equipe ainda é obscura

Para um modelo que atraiu tanta atenção, a falta de uma equipe claramente estabelecida é incomum. Há uma diferença entre um lançamento furtivo e um lançamento antecipado normal. Com muitos produtos de IA de ponta, mesmo as pré-visualizações limitadas ainda vêm com uma empresa visível, um grupo de pesquisa ou um laboratório conhecido. HappyHorse-1.0 parece menos simples do que isso.

Isso não significa automaticamente que algo está errado. Significa que os leitores devem ter cuidado para não preencher a lacuna com certeza onde só existe especulação.

A história do código aberto ainda não é totalmente convincente

Algumas páginas associadas ao HappyHorse-1.0 sugerem que o modelo está aberto ou caminhando para um lançamento aberto. Mas em situações como esta, a verdadeira questão é simples: as pessoas podem realmente acessar os pesos, o código, os termos da licença e a documentação de uma forma que permita a verificação independente?

Se a resposta ainda for “ainda não” ou “não está claro”, então o modelo não deve ser tratado como totalmente aberto em qualquer sentido prático, independentemente de como soe a linguagem de marketing.

As reivindicações técnicas ainda são, em sua maioria, reivindicações até que possam ser verificadas

Descrições de arquitetura, contagem de parâmetros, velocidade de geração, sincronização de áudio e vídeo e capacidade multilíngue podem ser importantes. Mas até que essas afirmações sejam apoiadas por acesso reproduzível, artefactos públicos ou testes independentes, devem ser tratadas como provisórias.

Isso não é ceticismo pelo ceticismo. É apenas uma disciplina básica. Os lançamentos de IA avançam tão rapidamente que afirmações técnicas atraentes podem espalhar-se muito mais rapidamente do que provas verificáveis.

O acesso ainda é tão importante quanto as classificações

Um modelo pode ser interessante e ainda assim não ser utilizável.

É fácil perder essa distinção quando um novo sistema começa a subir nas classificações ou a circular nas discussões do setor. Mas para criadores, equipes de produtos e desenvolvedores, o acesso não é um detalhe menor. É a diferença entre um modelo que é emocionante de observar e um modelo que pode realmente ser adotado.

Se não houver uma API estável, nenhuma documentação confiável e nenhum caminho de lançamento claro, então o modelo ainda é mais um sinal do que uma ferramenta.

Por que o hype é importante — e por que ainda não é suficiente

Vale a pena prestar atenção ao HappyHorse-1.0 porque a qualidade dos sinais de saída é importante. Se um modelo até então desconhecido começar a superar as expectativas em configurações de comparação cega, isso lhe dirá algo real. Isso sugere que tudo o que está por trás do nome não é apenas uma marca vazia.

Ao mesmo tempo, a qualidade do sinal é apenas uma parte da decisão.

Para usuários reais, a pergunta mais útil não é “Este modelo é interessante?” É “Posso usá-lo, confiar nele e planejar isso?” São perguntas diferentes e, neste momento, nem todas têm respostas igualmente fortes.

É por isso que HappyHorse-1.0 fica em uma zona intermediária interessante. Parece importante demais para ser ignorado, mas ainda muito incompleto para ser descrito como uma opção totalmente estabelecida.

Vale a pena assistir HappyHorse-1.0?

Sim - absolutamente.

Se você seguir de perto o espaço de vídeo da IA, HappyHorse-1.0 é o tipo de modelo que você deve ficar de olho. Tem impulso público suficiente, interesse relacionado à qualidade e posicionamento incomum suficiente para ser importante.

Mas “vale a pena assistir” não é o mesmo que “pronto para confiar”.

Se você é um criador que deseja apenas saber como será a próxima qualidade de vídeo de fronteira, HappyHorse-1.0 é claramente relevante. Se você faz parte de uma equipe que está tentando escolher um modelo de produção confiável hoje, ainda deve se preocupar mais com acesso, estabilidade, documentação e realidade de implantação do que com o momento impulsionado pelo mistério.

O que assistir a seguir

Se o HappyHorse-1.0 se tornar uma opção real de longo prazo, a mudança provavelmente se tornará óbvia através de alguns sinais concretos.

Detalhes do lançamento público

O desenvolvimento mais importante seria um caminho de lançamento verificável: pesos reais, um repositório real, termos de licenciamento adequados ou uma API documentada. Essa é a linha entre o fascínio e a adoção prática.

Testes independentes

A segunda coisa a observar é se terceiros começam a testá-lo de forma reproduzível. Uma vez que os usuários externos possam comparar qualidade, velocidade, consistência, resposta imediata e modos de falha sob condições repetíveis, a conversa se torna muito mais útil.

Propriedade e posicionamento claros

A terceira coisa é a simples transparência. Uma vez claras as pessoas ou organizações por trás do modelo, fica mais fácil avaliar incentivos, liberar credibilidade, apoiar expectativas e confiabilidade a longo prazo.

Até então, o modelo permanece convincente, mas não totalmente legível.

Perguntas frequentes

O que é HappyHorse-1.0?

HappyHorse-1.0 é um modelo de vídeo de IA que recentemente chamou a atenção devido ao forte interesse público em torno de sua qualidade de geração de vídeo e seu surgimento incomum em discussões baseadas em classificação.

O HappyHorse-1.0 é de código aberto?

Ainda não em nenhum sentido totalmente confirmado e praticamente utilizável. Existem reivindicações públicas em torno da abertura, mas essas reivindicações devem ser tratadas com cuidado até que os pesos, o código, as licenças e a documentação estejam claramente acessíveis.

Você pode usar o HappyHorse-1.0 agora?

Isso depende do tipo de acesso que você quer dizer. A discussão pública sugere interesse e visibilidade, mas o acesso prático, estável e pronto para produção parece muito menos certo do que o entusiasmo em torno do próprio modelo.

Quem criou o HappyHorse-1.0?

Essa ainda é uma das maiores questões em aberto. Parte da intriga atual do modelo vem do fato de que a identidade pública e a atribuição não têm sido tão claras como muitos leitores esperariam de um grande lançamento de IA.

O HappyHorse-1.0 é melhor que outros modelos de vídeo de IA?

Pode ser mais competitivo do que muitas pessoas esperavam, e é por isso que se tornou um verdadeiro tema de discussão. Mas “melhor” depende do que você mais valoriza: preferência cega, suporte de áudio, acesso à produção, estabilidade do fluxo de trabalho ou abertura.

Veredicto final

HappyHorse-1.0 é uma das histórias de vídeo de IA mais interessantes do momento porque combina duas coisas que normalmente não chegam juntas: um sinal de qualidade forte e um sinal de transparência fraco.

É exatamente por isso que o modelo parece tão importante e tão incerto ao mesmo tempo.

Se você se preocupa com o que há de mais moderno em geração de vídeo com IA, vale a pena assistir com atenção. Se você precisa de uma ferramenta confiável que possa realmente construir hoje, você deve permanecer mais conservador até que o acesso, a propriedade e a verificação se tornem mais claros.

No momento, o resumo mais honesto é este: HappyHorse-1.0 pode ser um material realmente inovador, mas ainda é uma história em andamento.