Czym jest HappyHorse-1.0? Co naprawdę wiemy o tym nowym modelu wideo AI

Czym jest HappyHorse-1.0? Co naprawdę wiemy o tym nowym modelu wideo AI

HappyHorse-1.0 to obecnie jeden z najczęściej omawianych modeli wideo AI, ale nie z zwykłego powodu. Nie pojawiło się z czystym uruchomieniem, publiczną stroną zespołu ani w pełni udokumentowanym interfejsem API. Zamiast tego zaczął przyciągać uwagę ze względu na to, jak dobrze wypadał w rankingach ślepych porównań, podczas gdy podstawowe pytania dotyczące dostępu, autorstwa i otwartości pozostały bez odpowiedzi.

Właśnie dzięki tej kombinacji ludzie zwracają na siebie uwagę.

Jeśli tylko przejrzysz nagłówki, HappyHorse-1.0 brzmi jak kolejny oczywisty przełom w wideo AI. Jeśli przyjrzysz się bliżej, obraz jest bardziej skomplikowany. Istnieją wyraźne sygnały społeczne, że warto przyjrzeć się temu modelowi, ale nadal istnieje znacząca rozbieżność między tym, co wydaje się prawdą, tym, co się twierdzi, a tym, co użytkownicy mogą dzisiaj faktycznie zweryfikować.

W tym przewodniku wyjaśniono to prostym językiem angielskim.

Dlaczego ludzie nagle mówią o HappyHorse-1.0

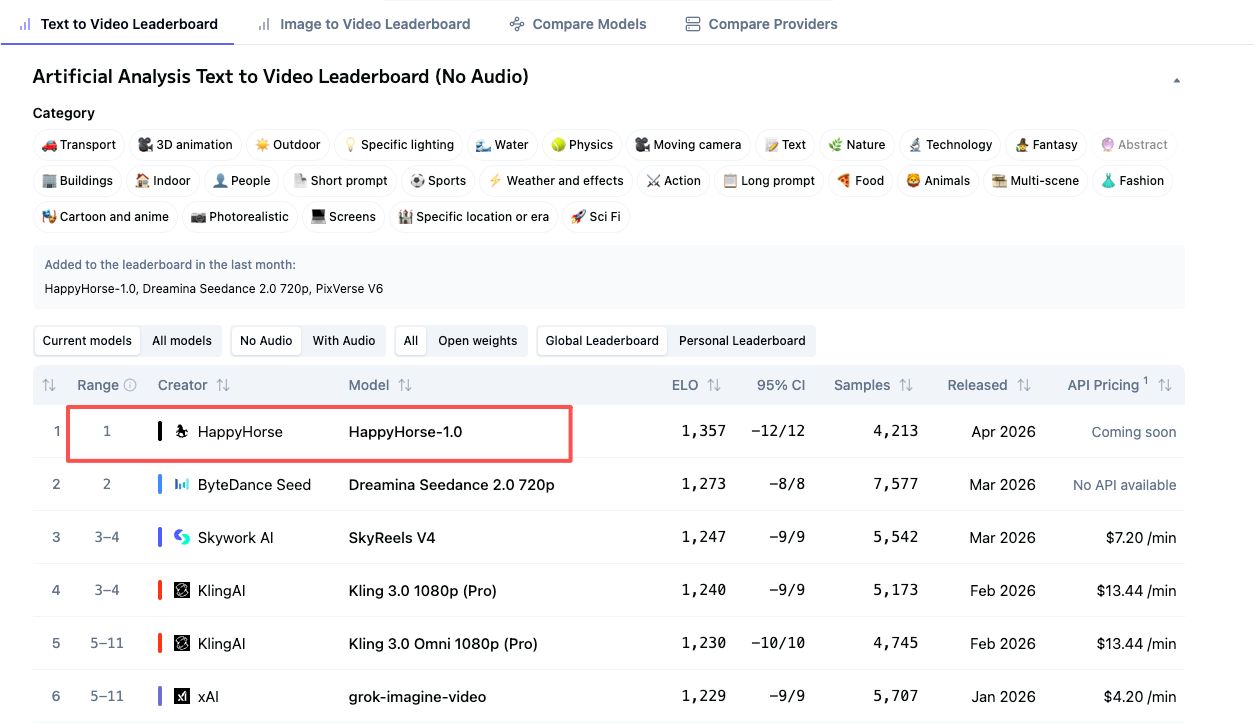

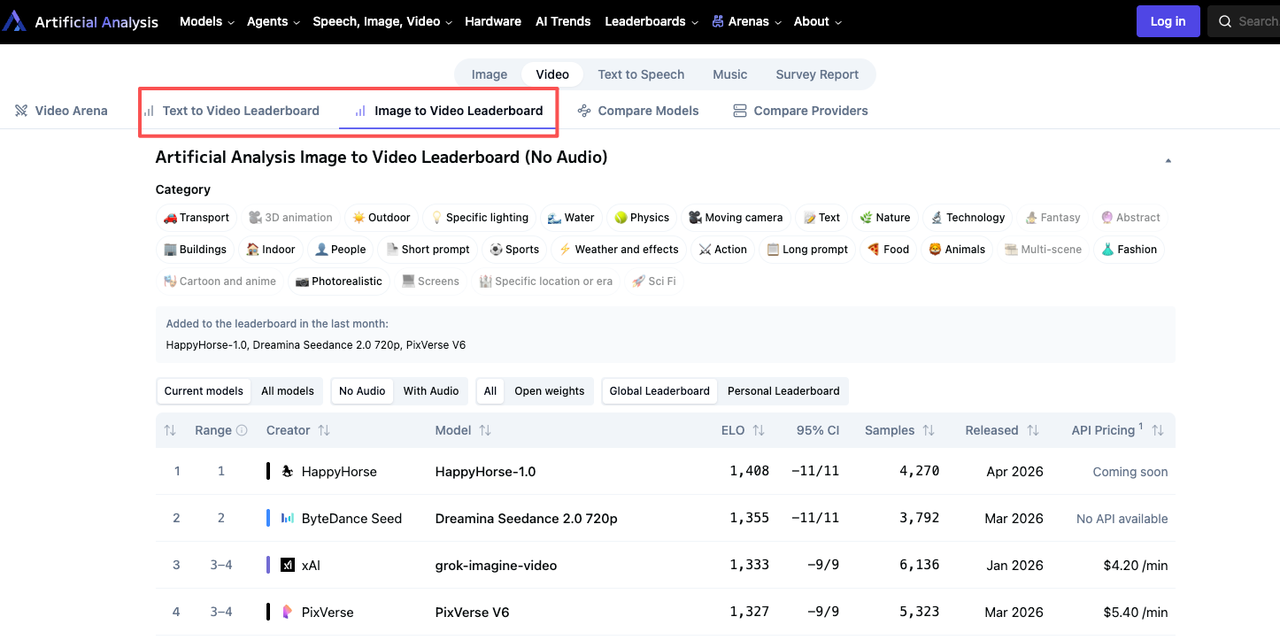

HappyHorse-1.0 zaczął pojawiać się w rozmowach, ponieważ znalazł się na szczycie rankingów modeli wideo, które opierają się na preferencjach niewidomych użytkowników, a nie na samodzielnie zgłaszanych twierdzeniach porównawczych. Ma to znaczenie, ponieważ premiery modeli AI często są opakowane w wybiórcze wersje demonstracyjne, starannie dobrane porównania i język marketingowy, dzięki któremu każde wydanie brzmi rewolucyjnie.

Środowisko ślepego porównania zmienia sygnał. Użytkownicy oceniają wyniki obok siebie, nie wiedząc, który model dał dany wynik. Kiedy wcześniej nieznana nazwa sprawdza się wyjątkowo dobrze w tym otoczeniu, ludzie szybko to zauważają.

To jest główny powód, dla którego HappyHorse-1.0 przeszedł od zapomnienia do poważnej dyskusji. To nie była kolejna strona modelowa, która twierdziła, że jest lepszej jakości. Był to model, który zdawał się przyciągać uwagę, zanim większość ludzi zorientowała się, kto go stworzył.

Co ma robić HappyHorse-1.0

Na podstawie dostępnych publicznie opisów HappyHorse-1.0 jest pozycjonowany jako nowoczesny model wideo AI, który może obsługiwać zarówno generowanie tekstu na wideo, jak i obrazu na wideo. Jest również opisywany jako obsługujący wyjścia obsługujące dźwięk i wielojęzyczne przypadki użycia, co jest jednym z powodów, dla których przyciąga większe zainteresowanie niż standardowy generator wideo.

W praktyce schemat jest prosty. Zamiast być przedstawiany jako wąski model demonstracyjny, HappyHorse-1.0 jest przedstawiany jako pełniejszy system generacji do tworzenia kinowego wideo, ruchu wizualnego i prawdopodobnie zsynchronizowanego wyjścia audiowizualnego.

Taka jest obietnica.

Ważniejsze pytanie brzmi: ile z tej obietnicy faktycznie można potwierdzić.

Co zostało obecnie potwierdzone

Jest kilka rzeczy, które wydają się zasadnie ugruntowane w dowodach publicznych.

1. HappyHorse-1.0 jest naprawdę widoczny, a nie tylko odosobniony szum

Nie jest to przypadek, w którym model pojawił się tylko na jednej stronie docelowej, a następnie został wzmocniony przez naśladujące blogi. Pojawiło się w wielu dyskusjach na temat aktualnych rankingów filmów AI, porównań modeli i opisów dostępu. Samo to nie świadczy o jakości, ale pokazuje, że niszowa ciekawość przeniosła się w szerszą uwagę branży.

2. Jest omawiany jako poważny model wideo, a nie demonstracja zabawki

Większość doniesień na temat HappyHorse-1.0 traktuje go jako pretendenta w tej samej rozmowie z narzędziami wideo AI wyższej klasy, a nie jako generator nowości. Model ten jest zwykle wymieniany w kontekście takim jak jakość zamiany tekstu na wideo, możliwość konwersji obrazu na wideo, realizm ruchu i wydajność w rankingach.

Takie ramy mają znaczenie, ponieważ umieszczają HappyHorse-1.0 w tej części rynku, w której oczekiwania są wyższe. Ludzie nie pytają, czy w ogóle da się na nim robić krótkie klipy. Pytają, czy może należeć do tego samego poziomu, co najsilniejsze dostępne obecnie modele wideo.

3. Publiczne twierdzenia dotyczące modelu są na tyle szczegółowe, że brzmią konkretnie

Jednym z powodów, dla których HappyHorse-1.0 wzbudził tak duże zainteresowanie, jest to, że twierdzenia na jego temat nie są niejasne. Publiczne opisy mówią o wyborze architektury, generowaniu multimodalnym, obsłudze języków i wysokiej jakości wydruku. Konkretność nie jest równa prawdzie, ale oznacza, że twierdzenia są na tyle konkretne, że można je później przetestować.

To bardzo różni się od niejasnego egzemplarza premierowego, w którym widnieje jedynie informacja, że dany model jest „następnej generacji” lub „najnowocześniejszy”.

Co jest nadal niejasne lub niezweryfikowane

W tym miejscu konieczna jest ostrożność.

Tożsamość zespołu jest wciąż niejasna

Jak na model, który wzbudził tak duże zainteresowanie, brak jasno ustalonego zespołu jest czymś niezwykłym. Istnieje różnica pomiędzy ukrytą premierą a normalną wcześniejszą wersją. W przypadku wielu pionierskich produktów AI nawet ograniczone wersje zapoznawcze nadal zawierają widoczną firmę, grupę badawczą lub znane laboratorium. HappyHorse-1.0 wydawało się mniej proste.

Nie oznacza to automatycznie, że coś jest nie tak. Oznacza to jednak, że czytelnicy powinni uważać, aby nie wypełnić pewnością luki tam, gdzie istnieją jedynie spekulacje.

Historia open source nie jest jeszcze w pełni przekonująca

Niektóre strony powiązane z HappyHorse-1.0 sugerują, że model jest otwarty lub zmierza w stronę otwartej wersji. Jednak w takich sytuacjach prawdziwe pytanie jest proste: czy ludzie rzeczywiście mogą uzyskać dostęp do wag, kodu, warunków licencji i dokumentacji w sposób umożliwiający niezależną weryfikację?

Jeśli odpowiedź nadal brzmi „jeszcze nie” lub „nie jest to jasne”, to modelu nie należy traktować jako w pełni otwartego w żadnym praktycznym sensie, niezależnie od tego, jak brzmi język marketingu.

Roszczenia techniczne nadal są w większości roszczeniami, dopóki nie zostaną sprawdzone

Opisy architektury, liczba parametrów, szybkość generowania, synchronizacja audio-wideo i obsługa wielu języków mogą być ważne. Jednak dopóki te twierdzenia nie zostaną poparte powtarzalnym dostępem, publicznymi artefaktami lub niezależnymi testami, należy je traktować jako tymczasowe.

To nie jest sceptycyzm dla samego sceptycyzmu. To po prostu podstawowa dyscyplina. Premiery sztucznej inteligencji postępują teraz tak szybko, że atrakcyjne twierdzenia techniczne mogą rozprzestrzeniać się znacznie szybciej niż weryfikowalne dowody.

Dostęp nadal jest tak samo ważny jak rankingi

Model może być interesujący, a mimo to nie nadawać się do użytku.

To rozróżnienie łatwo stracić, gdy nowy system zaczyna wspinać się w rankingach lub krążyć w dyskusjach branżowych. Jednak dla twórców, zespołów produktowych i programistów dostęp nie jest drobnostką. To jest różnica między modelem, który ekscytuje do oglądania, a modelem, który można faktycznie zastosować.

Jeśli nie ma stabilnego API, wiarygodnej dokumentacji i jasnej ścieżki wydania, model nadal jest raczej sygnałem niż narzędziem.

Dlaczego szum ma znaczenie i dlaczego to wciąż za mało

Warto zwrócić uwagę na HappyHorse-1.0, ponieważ jakość sygnałów wyjściowych ma znaczenie. Jeśli wcześniej nieznany model zacznie osiągać lepsze wyniki niż oczekiwania w ustawieniach ślepego porównania, mówi to coś realnego. Sugeruje, że to, co kryje się za nazwą, nie jest jedynie pustym brandingiem.

Jednocześnie jakość sygnału to tylko część decyzji.

Dla rzeczywistych użytkowników bardziej przydatne pytanie nie brzmi: „Czy ten model jest ekscytujący?” Pytanie brzmi: „Czy mogę z tego skorzystać, zaufać mu i planować wokół niego?” To różne pytania i obecnie nie na wszystkie można znaleźć równie mocne odpowiedzi.

Dlatego HappyHorse-1.0 znajduje się w interesującej środkowej strefie. Wydaje się, że jest to zbyt ważne, aby je zignorować, ale wciąż zbyt niekompletne, aby można je było opisać jako w pełni ustaloną opcję.

Czy warto obejrzeć HappyHorse-1.0?

Tak – absolutnie.

Jeśli uważnie śledzisz przestrzeń wideo AI, HappyHorse-1.0 jest modelem, na który powinieneś zwrócić uwagę. Ma wystarczający rozmach publiczny, wystarczające zainteresowanie jakością i wystarczająco nietypowe pozycjonowanie, aby mieć znaczenie.

Ale „warte obejrzenia” to nie to samo, co „na których można polegać”.

Jeśli jesteś twórcą, który chce tylko wiedzieć, jak może wyglądać pionierska jakość wideo w przyszłości, HappyHorse-1.0 jest z pewnością odpowiedni. Jeśli jesteś zespołem próbującym dziś wybrać niezawodny model produkcyjny, nadal powinieneś bardziej troszczyć się o dostęp, stabilność, dokumentację i rzeczywistość wdrażania niż o dynamikę wynikającą z tajemnic.

Co obejrzeć dalej

Jeśli HappyHorse-1.0 stanie się naprawdę długoterminową opcją, zmiana prawdopodobnie stanie się oczywista dzięki kilku konkretnym sygnałom.

Szczegóły publikacji publicznej

Najważniejszym osiągnięciem byłaby możliwa do zweryfikowania ścieżka wydania: rzeczywiste wagi, prawdziwe repozytorium, odpowiednie warunki licencyjne lub udokumentowane API. To jest granica pomiędzy fascynacją a praktyczną adopcją.

Niezależne testy

Drugą rzeczą, na którą należy zwrócić uwagę, jest to, czy osoby trzecie zaczną testować to w powtarzalny sposób. Gdy użytkownicy zewnętrzni będą mogli porównać jakość, szybkość, spójność, szybką reakcję i tryby awarii w powtarzalnych warunkach, rozmowa stanie się znacznie bardziej użyteczna.

Wyczyść własność i pozycję

Trzecia rzecz to prosta przejrzystość. Gdy osoby lub organizacje stojące za modelem będą jasne, łatwiej będzie ocenić zachęty, zapewnić wiarygodność, oczekiwania w zakresie wsparcia i długoterminową niezawodność.

Do tego czasu model pozostaje atrakcyjny, ale nie w pełni czytelny.

Często zadawane pytania

Co to jest HappyHorse-1.0?

HappyHorse-1.0 to model wideo oparty na sztucznej inteligencji, który niedawno przyciągnął uwagę ze względu na duże zainteresowanie opinii publicznej jakością generowania wideo oraz jego niezwykłe pojawienie się w dyskusjach opartych na rankingach.

Czy HappyHorse-1.0 jest oprogramowaniem typu open source?

Jeszcze nie w żadnym w pełni potwierdzonym, praktycznie użytecznym sensie. Istnieją publiczne twierdzenia dotyczące otwartości, ale należy je traktować ostrożnie, dopóki wagi, kod, licencje i dokumentacja nie będą wyraźnie dostępne.

Czy możesz teraz używać HappyHorse-1.0?

To zależy, jaki rodzaj dostępu masz na myśli. Dyskusja publiczna sugeruje zainteresowanie i widoczność, ale praktyczny, stabilny i gotowy do produkcji dostęp wydaje się znacznie mniej pewny niż szum wokół samego modelu.

Kto stworzył HappyHorse-1.0?

To wciąż jedno z największych otwartych pytań. Część obecnej intrygi modelu wynika z faktu, że tożsamość publiczna i atrybucja nie były tak jasne, jak wielu czytelników oczekiwałoby od ważnej wersji sztucznej inteligencji.

Czy HappyHorse-1.0 jest lepszy od innych modeli wideo AI?

Może być bardziej konkurencyjny, niż wielu się spodziewało, dlatego stał się prawdziwym tematem dyskusji. Ale „lepiej” zależy od tego, co cenisz najbardziej: preferencje niewidomych, wsparcie audio, dostęp do produkcji, stabilność przepływu pracy czy otwartość.

Ostateczny werdykt

HappyHorse-1.0 to jedna z ciekawszych obecnie historii wideo o sztucznej inteligencji, ponieważ łączy w sobie dwie rzeczy, które zwykle nie idą w parze: sygnał wysokiej jakości i sygnał słabej przezroczystości.

Właśnie dlatego model wydaje się tak ważny, a jednocześnie tak niepewny.

Jeśli zależy Ci na najnowocześniejszych rozwiązaniach w zakresie generowania wideo AI, warto uważnie się temu przyjrzeć. Jeśli potrzebujesz niezawodnego narzędzia, na którym możesz już dziś budować, powinieneś pozostać bardziej konserwatywny, dopóki dostęp, własność i weryfikacja nie staną się wyraźniejsze.

W tej chwili najbardziej uczciwe podsumowanie jest takie: HappyHorse-1.0 może być naprawdę przełomowym materiałem, ale wciąż jest to historia w toku.