Wat is HappyHorse-1.0? Wat we echt weten over dit nieuwe AI-videomodel

Wat is HappyHorse-1.0? Wat we echt weten over dit nieuwe AI-videomodel

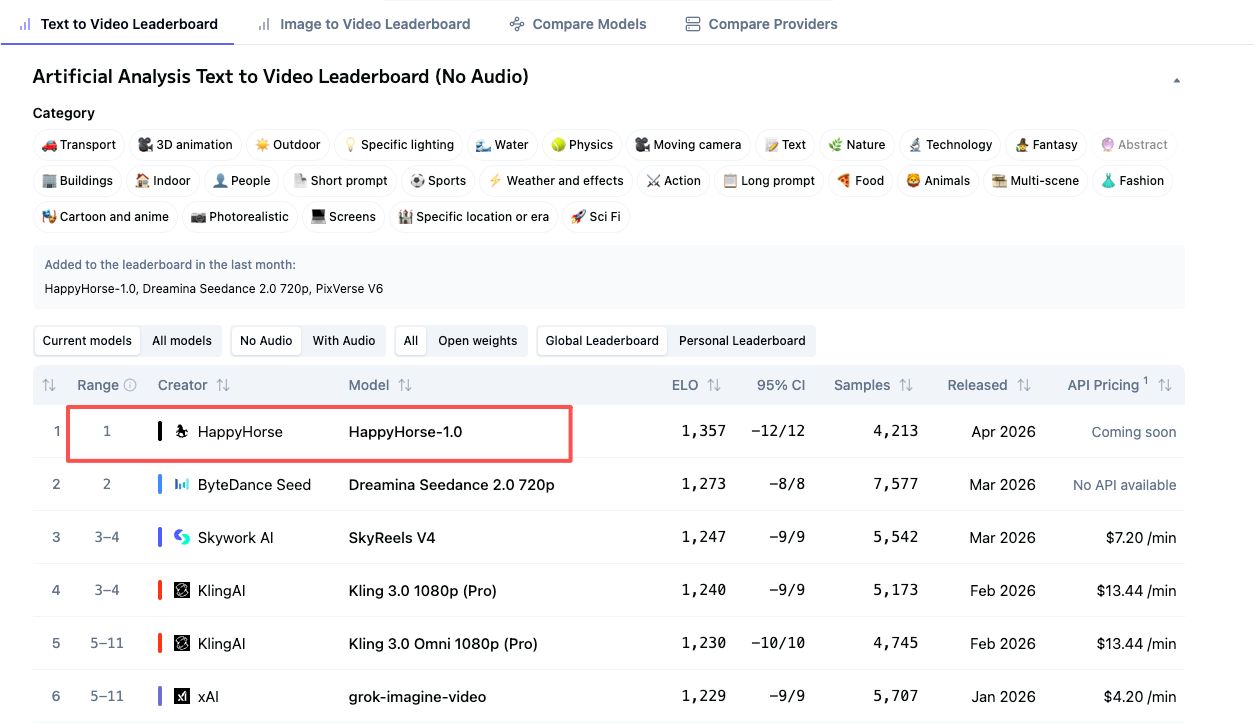

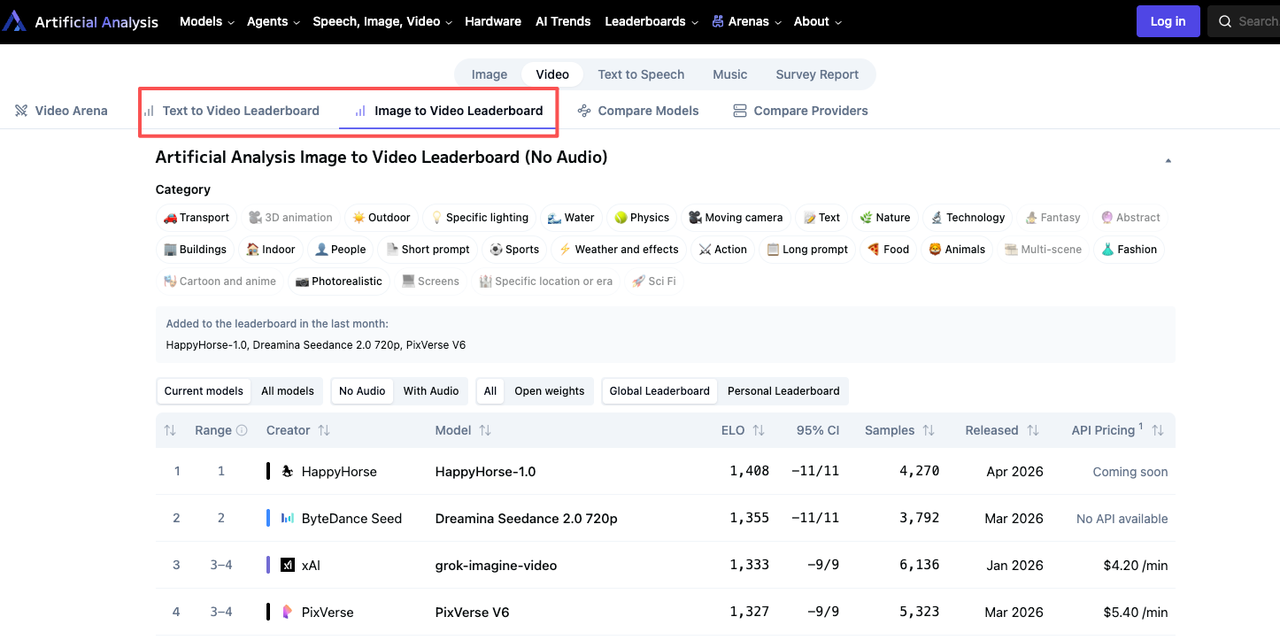

HappyHorse-1.0 is momenteel een van de meest spraakmakende AI-videomodellen, maar niet om de gebruikelijke reden. Het kwam niet met een schone lancering, een openbare teampagina of een volledig gedocumenteerde API. In plaats daarvan begon het de aandacht te trekken vanwege hoe goed het leek te presteren in blinde vergelijkingsranglijsten, terwijl fundamentele vragen over toegang, auteurschap en openheid onbeantwoord bleven.

Die combinatie is precies waarom mensen opletten.

Als je alleen maar de krantenkoppen doorbladert, klinkt HappyHorse-1.0 als de volgende voor de hand liggende doorbraak in AI-video. Als je beter kijkt, is het beeld ingewikkelder. Er zijn sterke publieke signalen dat het model de moeite waard is om te bekijken, maar er gaapt nog steeds een betekenisvolle kloof tussen wat waar lijkt te zijn, wat wordt beweerd en wat gebruikers vandaag de dag daadwerkelijk kunnen verifiëren.

Deze gids legt dat uit in gewoon Engels.

Waarom mensen ineens over HappyHorse-1.0 praten

HappyHorse-1.0 verscheen in gesprekken omdat het bovenaan de ranglijst van videomodellen verscheen die afhankelijk zijn van blinde gebruikersvoorkeuren in plaats van zelfgerapporteerde benchmarkclaims. Dat is van belang omdat de lancering van AI-modellen vaak wordt verpakt in selectieve demo’s, zorgvuldig gekozen vergelijkingen en marketingtaal die elke release revolutionair laat klinken.

Een blinde vergelijkingsomgeving verandert het signaal. Gebruikers beoordelen resultaten naast elkaar zonder te weten welk model welk resultaat heeft opgeleverd. Wanneer een voorheen onbekende naam in die setting ongewoon goed presteert, merken mensen het snel.

Dat is de belangrijkste reden waarom HappyHorse-1.0 van onduidelijkheid naar serieuze discussie is overgegaan. Het was niet zomaar een modelpagina die betere kwaliteit claimde. Het was een model dat de aandacht leek te trekken voordat de meeste mensen zelfs maar wisten wie het maakte.

Wat HappyHorse-1.0 zou moeten doen

Op basis van openbare beschrijvingen is HappyHorse-1.0 gepositioneerd als een modern AI-videomodel dat zowel tekst-naar-video als afbeelding-naar-video-generatie aankan. Er wordt ook beschreven dat het audiobewuste uitvoer en meertalige gebruiksscenario's ondersteunt, wat een van de redenen is dat het meer nieuwsgierigheid heeft gewekt dan een standaard videogenerator.

Praktisch gezien is de pitch eenvoudig. In plaats van te worden ingekaderd als een beperkt demomodel, wordt HappyHorse-1.0 gepresenteerd als een completer generatiesysteem voor filmische videocreatie, visuele beweging en mogelijk gesynchroniseerde audiovisuele output.

Dat is de belofte.

De belangrijker vraag is hoeveel van die belofte daadwerkelijk kan worden bevestigd.

Wat momenteel feitelijk wordt bevestigd

Er zijn een paar dingen die redelijkerwijs gegrond lijken te zijn op openbaar bewijsmateriaal.

1. HappyHorse-1.0 heeft echte zichtbaarheid, niet slechts een geïsoleerde hype

Dit is niet het geval waarbij een model slechts op één enkele landingspagina verscheen en vervolgens werd versterkt door copycat-blogs. Het is naar voren gekomen in meerdere discussies over de huidige AI-videoranglijsten, modelvergelijkingen en toegangsbeschrijvingen. Dat alleen is geen bewijs van kwaliteit, maar het laat wel zien dat het van niche-nieuwsgierigheid is overgegaan naar bredere aandacht van de industrie.

2. Het wordt besproken als een serieus videomodel, niet als een speelgoeddemo

Het grootste deel van de berichtgeving rond HappyHorse-1.0 behandelt het als een kanshebber in hetzelfde gesprek als geavanceerde AI-videotools in plaats van als een nieuwigheidsgenerator. Het model wordt meestal genoemd in contexten zoals tekst-naar-videokwaliteit, beeld-naar-video-mogelijkheden, bewegingsrealisme en rankingprestaties.

Die framing is belangrijk omdat HappyHorse-1.0 hierdoor in het deel van de markt wordt geplaatst waar de verwachtingen hoger zijn. Mensen vragen niet of het überhaupt korte clips kan maken. Ze vragen zich af of het misschien in hetzelfde niveau thuishoort als de sterkste videomodellen die momenteel beschikbaar zijn.

3. Publieke claims rond het model zijn gedetailleerd genoeg om specifiek te klinken

Eén reden waarom HappyHorse-1.0 zoveel belangstelling heeft gewekt, is dat de beweringen eromheen niet vaag zijn. In de openbare beschrijvingen wordt gesproken over architectuurkeuzes, multimodale generatie, taalondersteuning en hoogwaardige uitvoerkwaliteit. Specificiteit is niet hetzelfde als waarheid, maar het betekent wel dat de beweringen concreet genoeg zijn om later te worden getest.

Dat is heel anders dan een vage lanceringskopie die alleen zegt dat een model ‘nextgeneration’ of ‘state of the art’ is.

Wat is nog steeds onduidelijk of niet geverifieerd

Dit is waar voorzichtigheid geboden is.

Teamidentiteit is nog steeds duister

Voor een model dat zoveel aandacht heeft getrokken, is het ontbreken van een duidelijk gevestigd team ongebruikelijk. Er is een verschil tussen een stealth-lancering en een normale vroege release. Bij veel grensverleggende AI-producten worden zelfs beperkte previews nog steeds geleverd met een zichtbaar bedrijf, een onderzoeksgroep of een bekend laboratorium. HappyHorse-1.0 voelde minder eenvoudig aan dan dat.

Dat betekent niet automatisch dat er iets mis is. Het betekent wel dat lezers ervoor moeten oppassen de leemte niet met zekerheid op te vullen waar alleen maar speculatie bestaat.

Het open-sourceverhaal is nog niet helemaal overtuigend

Sommige pagina's die verband houden met HappyHorse-1.0 suggereren dat het model open is of op weg is naar een open release. Maar in situaties als deze is de echte vraag simpel: kunnen mensen daadwerkelijk toegang krijgen tot de gewichten, de code, de licentievoorwaarden en de documentatie op een manier die onafhankelijke verificatie mogelijk maakt?

Als het antwoord nog steeds ‘nog niet’ of ‘niet duidelijk’ is, mag het model in praktische zin niet als volledig open worden beschouwd, hoe de marketingtaal ook klinkt.

Technische claims zijn nog steeds meestal claims totdat ze kunnen worden gecontroleerd

Architectuurbeschrijvingen, parametertellingen, generatiesnelheid, audio-videosynchronisatie en meertalige mogelijkheden kunnen allemaal belangrijk zijn. Maar totdat deze beweringen worden ondersteund door reproduceerbare toegang, openbare artefacten of onafhankelijke tests, moeten ze als voorlopig worden behandeld.

Dat is geen scepticisme omwille van het scepticisme. Het is gewoon basisdiscipline. AI-lanceringen gaan nu zo snel dat aantrekkelijke technische claims zich veel sneller kunnen verspreiden dan verifieerbaar bewijs.

Toegang is nog steeds net zo belangrijk als rankings

Een model kan interessant zijn en toch niet bruikbaar.

Dat onderscheid is gemakkelijk te verliezen als een nieuw systeem op de ranglijst begint te stijgen of in de discussie in de sector circuleert. Maar voor makers, productteams en ontwikkelaars is toegang geen klein detail. Het is het verschil tussen een model dat spannend is om naar te kijken en een model dat daadwerkelijk kan worden overgenomen.

Als er geen stabiele API is, geen betrouwbare documentatie en geen duidelijk releasepad, dan is het model nog steeds meer een signaal dan een hulpmiddel.

Waarom de hype ertoe doet — en waarom het nog steeds niet genoeg is

HappyHorse-1.0 is de moeite waard om aandacht aan te besteden, omdat signalen van uitgangskwaliteit ertoe doen. Als een voorheen onbekend model de verwachtingen gaat overtreffen in blinde vergelijkingsomgevingen, vertelt dat u iets reëels. Het suggereert dat wat er achter de naam zit, niet alleen maar loze branding is.

Tegelijkertijd is het kwaliteitssignaal slechts een deel van de beslissing.

Voor daadwerkelijke gebruikers is de nuttigere vraag niet: “Is dit model spannend?” Het is: "Kan ik het gebruiken, erop vertrouwen en eromheen plannen?" Dat zijn verschillende vragen, en op dit moment hebben ze niet allemaal even sterke antwoorden.

Daarom bevindt HappyHorse-1.0 zich in een interessante middenzone. Het voelt te belangrijk om te negeren, maar nog steeds te onvolledig om te beschrijven als een volledig gevestigde optie.

Is HappyHorse-1.0 het kijken waard?

Ja – absoluut.

Als je de AI-videoruimte op de voet volgt, is HappyHorse-1.0 het soort model dat je in de gaten moet houden. Het heeft voldoende publieke dynamiek, voldoende kwaliteitsgerelateerde interesse en voldoende ongebruikelijke positionering om er toe te doen.

Maar ‘het bekijken waard’ is niet hetzelfde als ‘klaar om op te vertrouwen’.

Als je een maker bent die alleen maar wil weten hoe grensverleggende videokwaliteit er vervolgens uit zou kunnen zien, dan is HappyHorse-1.0 duidelijk relevant. Als je vandaag de dag een team bent dat probeert een betrouwbaar productiemodel te kiezen, moet je nog steeds meer geven om toegang, stabiliteit, documentatie en implementatierealiteit dan om door mysterie gedreven momentum.

Wat je nu moet bekijken

Als HappyHorse-1.0 een echte langetermijnoptie wordt, zal de verschuiving waarschijnlijk duidelijk worden via een paar concrete signalen.

Details van openbare release

De belangrijkste ontwikkeling zou een verifieerbaar releasepad zijn: daadwerkelijke gewichten, een echte repository, goede licentievoorwaarden of een gedocumenteerde API. Dat is de grens tussen fascinatie en praktische adoptie.

Onafhankelijke tests

Het tweede waar je op moet letten is of derde partijen het op een reproduceerbare manier gaan testen. Zodra externe gebruikers kwaliteit, snelheid, consistentie, snelle respons en faalwijzen onder herhaalbare omstandigheden kunnen vergelijken, wordt het gesprek veel nuttiger.

Duidelijk eigenaarschap en positionering

Het derde ding is eenvoudige transparantie. Zodra de mensen of organisatie achter het model duidelijk zijn, wordt het gemakkelijker om prikkels te evalueren, geloofwaardigheid vrij te maken, verwachtingen te ondersteunen en betrouwbaarheid op de lange termijn te garanderen.

Tot die tijd blijft het model overtuigend, maar niet volledig leesbaar.

Veelgestelde vragen

Wat is HappyHorse-1.0?

HappyHorse-1.0 is een AI-videomodel dat onlangs de aandacht heeft getrokken vanwege de sterke publieke belangstelling voor de kwaliteit van de videogeneratie en de ongebruikelijke opkomst ervan in ranking-gedreven discussies.

Is HappyHorse-1.0 open source?

Nog niet in een volledig bevestigde, praktisch bruikbare zin. Er zijn publieke claims rond openheid, maar deze claims moeten zorgvuldig worden behandeld totdat gewichten, codes, licenties en documentatie duidelijk toegankelijk zijn.

Kun je HappyHorse-1.0 nu gebruiken?

Dat hangt ervan af wat voor soort toegang je bedoelt. De publieke discussie duidt op interesse en zichtbaarheid, maar praktische, stabiele, productieklare toegang lijkt veel minder zeker dan de hype rond het model zelf.

Wie heeft HappyHorse-1.0 gemaakt?

Dat is nog steeds een van de grootste open vragen. Een deel van de huidige intriges van het model komt voort uit het feit dat de publieke identiteit en toeschrijving niet zo duidelijk zijn geweest als veel lezers zouden verwachten van een grote AI-release.

Is HappyHorse-1.0 beter dan andere AI-videomodellen?

Het kan competitiever zijn dan veel mensen hadden verwacht, en daarom is het een echt onderwerp van discussie geworden. Maar ‘beter’ hangt af van wat u het meest waardeert: blinde voorkeur, audio-ondersteuning, productietoegang, stabiliteit van de workflow of openheid.

Eindoordeel

HappyHorse-1.0 is een van de interessantere AI-videoverhalen van dit moment omdat het twee dingen combineert die normaal niet samenkomen: een sterk kwaliteitssignaal en een zwak transparantiesignaal.

Dat is precies waarom het model tegelijkertijd zo belangrijk en zo onzeker aanvoelt.

Als je geïnteresseerd bent in de allernieuwste AI-videogeneratie, is het de moeite waard om goed te kijken. Als je een betrouwbare tool nodig hebt waar je vandaag de dag omheen kunt bouwen, moet je conservatiever blijven totdat toegang, eigendom en verificatie duidelijker worden.

Op dit moment is de meest eerlijke samenvatting deze: HappyHorse-1.0 mag dan wel echt baanbrekend materiaal zijn, maar het is nog steeds een verhaal in uitvoering.